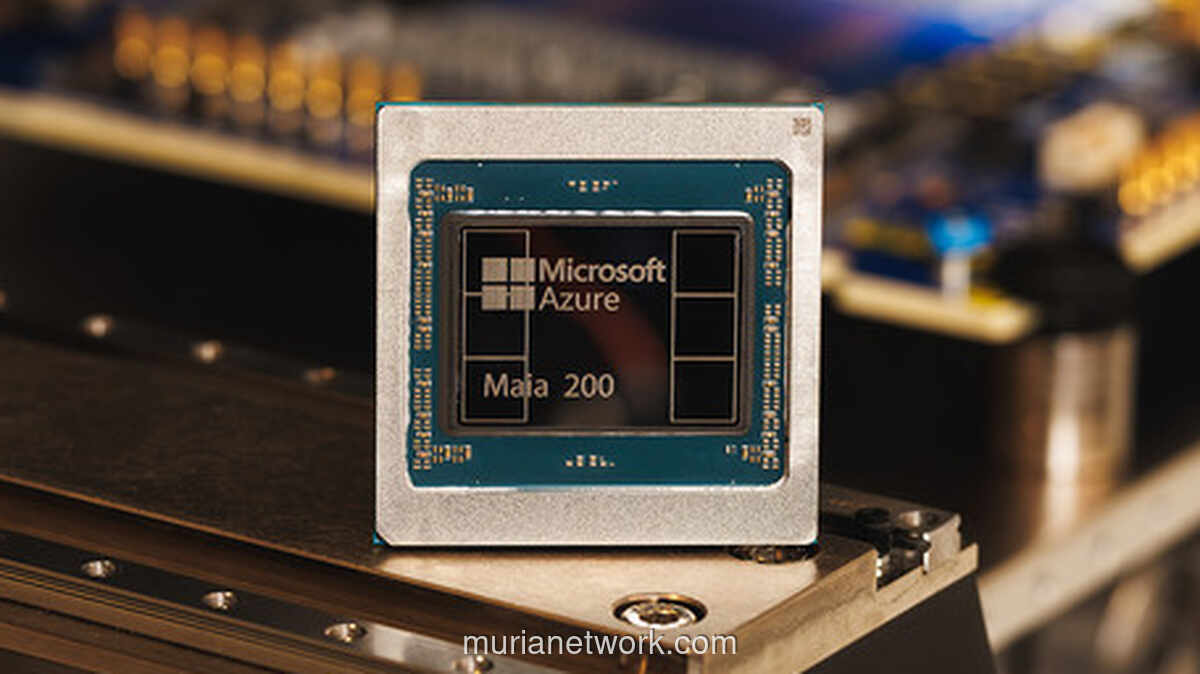

Microsoft baru saja mengumumkan kehadiran chip terbarunya, Maia 200. Ini adalah prosesor khusus yang mereka rancang untuk satu tujuan utama: mempercepat dan membuat proses inferensi kecerdasan buatan jadi jauh lebih efisien. Bagi perusahaan, Maia 200 bukan sekadar chip biasa. Mereka menyebutnya sebagai tulang punggung silikon untuk menjalankan model AI berskala besar, tapi dengan konsumsi daya yang lebih hemat.

Sebagai penerus Maia 100 yang diluncurkan tahun lalu, chip ini membawa lompatan teknis yang cukup signifikan. Menurut rilis resmi, Maia 200 dibekali dengan lebih dari 100 miliar transistor di dalamnya. Hasilnya? Kinerjanya bisa mencapai lebih dari 10 petaflops pada presisi 4-bit, dan sekitar 5 petaflops untuk presisi 8-bit. Angka-angka itu jelas jauh meninggalkan kemampuan generasi sebelumnya.

Nah, bagi yang belum terlalu familiar, inferensi AI itu adalah tahap ketika model kecerdasan buatan sudah jadi dan dijalankan untuk menghasilkan jawaban atau output. Ini berbeda fase dengan proses pelatihan model itu sendiri. Seiring bisnis AI makin meluas, biaya untuk tahap inferensi ini ternyata membengkak dan jadi komponen operasional yang besar.

Makanya, tidak heran jika perusahaan-perusahaan teknologi sekarang berlomba mencari solusi. Mereka ingin menekan biaya itu, tapi tanpa harus mengorbankan performa. Dan Microsoft berharap Maia 200 bisa menjadi jawabannya.

Scott Guthrie, Executive Vice President Cloud AI Microsoft, menjelaskan kapasitas chip ini.

"Secara praktis, satu node Maia 200 dapat dengan mudah menjalankan model-model terbesar saat ini, dengan ruang kapasitas yang masih luas untuk model yang lebih besar di masa depan," ujarnya.

Peluncuran chip ini juga bukan hal yang terjadi dalam ruang hampa. Ini mencerminkan sebuah tren besar di industri. Perusahaan-perusahaan raksasa teknologi kini mulai serius mengembangkan chip mereka sendiri. Tujuannya jelas: mengurangi ketergantungan pada GPU Nvidia yang selama ini mendominasi pasar komputasi AI.

Google punya TPU yang bisa diakses lewat layanan cloud-nya. Di sisi lain, Amazon juga tidak mau ketinggalan dengan mengembangkan chip akselerator AI bernama Trainium. Versi terbarunya, Trainium3, bahkan sudah meluncur Desember 2025 lalu. Chip-cip buatan sendiri ini membantu mereka memindahkan sebagian beban komputasi dari GPU Nvidia dan, tentu saja, berusaha menekan biaya perangkat keras secara keseluruhan.

Artikel Terkait

Google Sediakan Fitur Bawaan Lacak, Kunci, hingga Hapus Data Ponsel Android yang Hilang

WhatsApp Bisa Diakses Tanpa Scan Kode QR, Pakar Ingatkan Risiko Penyadapan dan Pelanggaran Privasi

YouTube Batasi Akses Pengguna di Bawah 16 Tahun di Indonesia Patuhi PP Tunas

Peneliti Temukan Spesies Baru Laba-laba Hantu di Habitat Bambu Jawa